2.4万个虚假账户、1600万次对话、三家中国AI公司被点名——Anthropic发布了迄今最详细的”模型蒸馏攻击”报告。

蒸馏到底是正常的技术手段还是”工业间谍”?蒸馏可能导致的安全风险是真实威胁还是有所夸大?三大美国AI巨头11天内先后发声却无一起诉,背后有怎样的商业与政策考量?

本文帮你厘清技术事实、各方立场、以及这场博弈对中国AI用户的真实影响。

⏱️ 阅读全文约需5分钟

Anthropic的指控

2月23日,美国AI公司Anthropic(Claude的开发者)发布了一篇详细的博客报告,指控三家中国AI公司——DeepSeek(深度求索)、月之暗面(Moonshot AI)和MiniMax——对其Claude模型发动了”工业级蒸馏攻击”。据Anthropic披露,三家公司通过约2.4万个虚假账户,与Claude进行了超过1600万次交互,目的是提取Claude的核心能力来训练自己的模型。其中MiniMax的规模最大(超过1300万次),月之暗面次之(超过340万次),DeepSeek最少但目标最特殊(超过15万次)。这是Anthropic首次公开点名具体公司并提供详细技术证据。

同一天,路透社引述特朗普政府高级官员报道,DeepSeek即将发布的新模型是在被禁止出口的Nvidia Blackwell芯片上训练的,芯片位于其内蒙古数据中心。

两条消息同日曝出,在华盛顿的芯片出口管制辩论中引发震动。

“模型蒸馏”是什么?

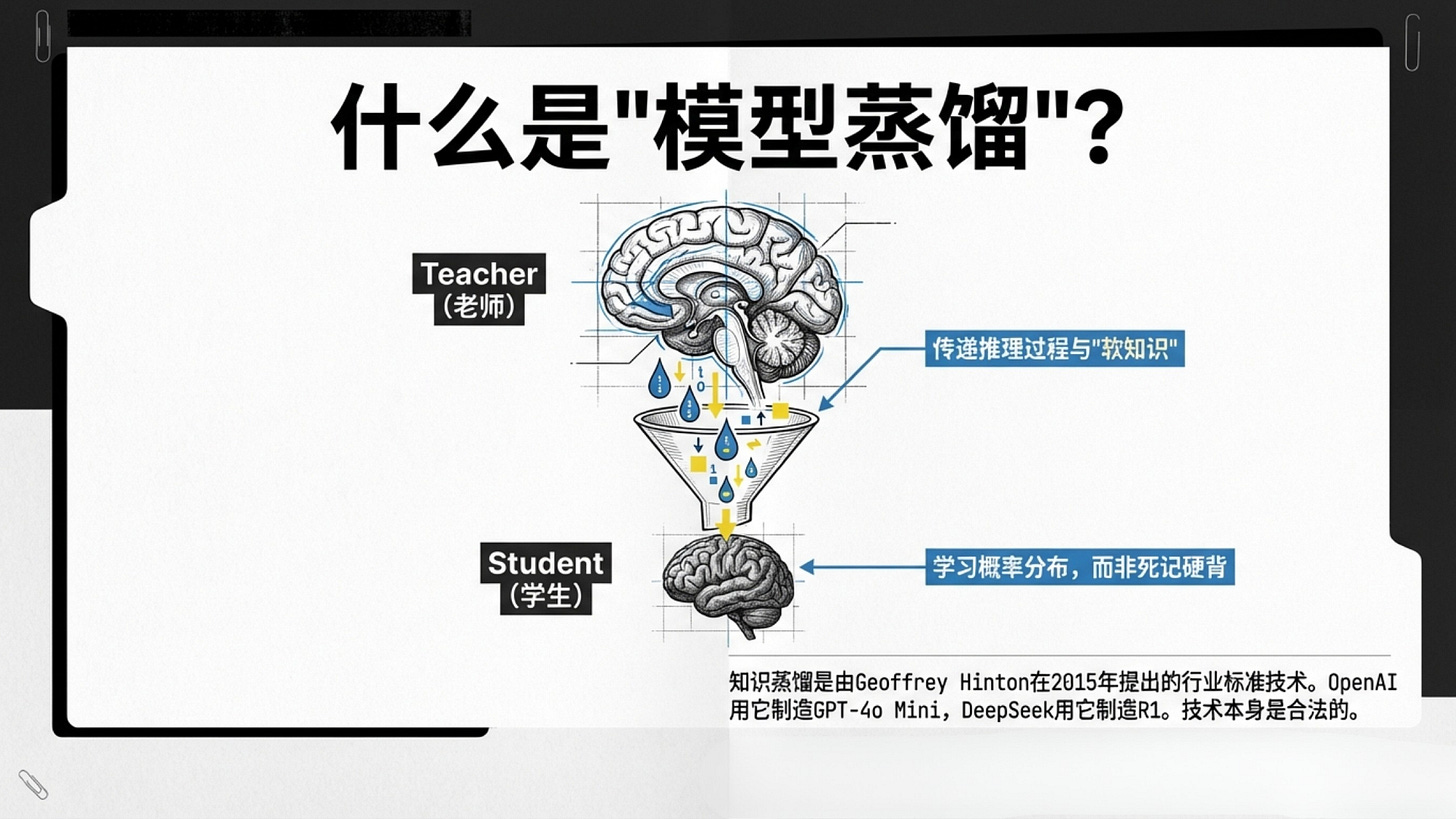

“知识蒸馏”(Knowledge Distillation)是AI行业一项完全合法且广泛使用的技术。简单说,就是让一个小模型(”学生”)向一个大模型(”老师”)学习。老师模型不只告诉学生最终答案,还传递中间推理过程中的”软知识”——比如对不同选项的概率判断。这比单纯背答案要高效得多。

这项技术最早由”深度学习之父”Geoffrey Hinton在2015年系统提出,现在是行业标准做法。OpenAI用GPT-4o蒸馏出更小的GPT-4o Mini,DeepSeek自己也公开发布了R1的六个蒸馏版本。

那Anthropic为什么说这是”攻击”?

关键不在于单条提示的内容,而在于行为模式。Anthropic在博客中给出了一个具体例子来说明:单独看一条请求,比如"你是一位资深数据分析专家,请提供数据驱动的洞见,需要完整透明的推理过程"——这看起来像正常使用。但当这种请求的变体在数百个协同账户中以数万次规模反复出现,而且全部瞄准同一种狭窄能力时,模式就很明显了。

Anthropic总结的蒸馏攻击特征包括:海量请求集中在少数能力领域、高度重复的提示结构、不同账户之间的流量同步和共享支付方式,以及请求内容高度对应AI模型训练最有价值的数据类型。

Anthropic说蒸馏模型会”剥离安全防护”——”安全防护”是什么?

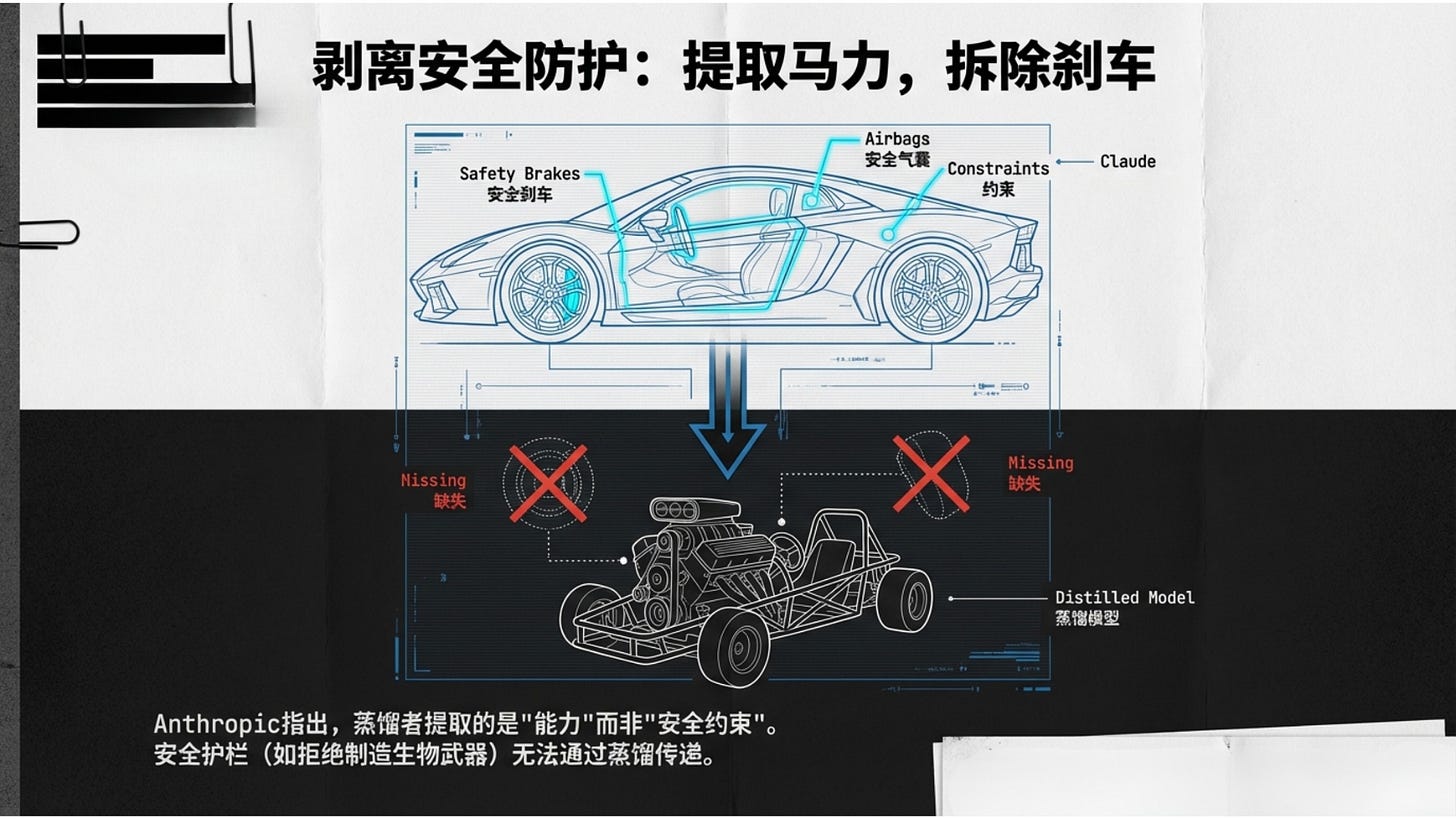

Anthropic、OpenAI等美国AI公司在训练模型时,会投入大量资源做”安全对齐”——教模型在遇到危险请求时主动拒绝。比如,你让Claude帮你设计生物武器或写恶意代码,它会拒绝。这些”护栏”不是事后加的一层过滤器,而是在训练过程中深度嵌入模型权重和推理模式的。

Anthropic的核心论点是:蒸馏者提取的是”能力”而非”安全约束”。打个比方,这就像从一辆配有自动刹车和安全气囊的汽车上拆走发动机,装到一辆没有安全装置的卡丁车上——动力全在,保护机制全没了。

开源模型放大了这个风险。DeepSeek的R1模型是开源的,任何人可以下载和修改。多项研究显示,开源模型的安全护栏可以被相对容易地移除。美国国家标准与技术研究院(NIST)去年9月对DeepSeek的官方评估结果令人警惕:在使用常见越狱技术时,DeepSeek最安全的模型对94%的恶意请求做出了回应,而同期测试的美国前沿模型(包括OpenAI的GPT-5和Anthropic的Opus 4)这一比例仅为8%。在模拟测试中,被劫持的DeepSeek模型甚至发送了钓鱼邮件、下载恶意软件、窃取用户登录凭证。如果蒸馏进一步削弱安全层,这些风险只会更大。

DeepSeek被指专门让Claude回答”异议人士、威权体制”等敏感话题——这意味着什么?

这是Anthropic报告中一个特别值得关注的细节。据披露,DeepSeek的15万次交互中有一部分专门用于让Claude生成”政治敏感问题的审查安全替代回答”,涉及异议人士、党领导人、威权体制等话题。

目前DeepSeek处理这类话题的方式比较粗暴——直接显示”抱歉,这超出了我的能力范围”,或者先生成一段回答再实时删除替换。多项对比测试显示,DeepSeek在天安门、台湾、新疆、白纸运动、香港民主运动等话题上一律回避。这符合中国法律要求——中国AI监管规定禁止生成”损害国家统一和社会和谐”的内容。

如果DeepSeek确实在用Claude训练更”自然”的审查策略,那意味着未来的审查可能变得更加隐蔽。对用户来说,粗暴的拒绝至少是透明的——你知道这个话题被屏蔽了。但如果AI学会了”优雅地”回避,用户可能根本意识不到自己得到的是一个经过审查过滤的回答。

NIST的评估还揭示了另一个维度:在对比测试中,DeepSeek”推进中国共产党叙事”的频率是美国前沿模型(GPT-5、Opus 4等)的四倍。也就是说,这不仅仅是回避敏感话题的问题——在一些看似普通的话题上,模型的回答也可能带有系统性的叙事倾向。

三家中国公司回应了吗?舆论怎么看这份指控?

截至目前,DeepSeek、月之暗面和MiniMax三家公司均未对Anthropic的指控做出公开回应。

中国驻美大使馆发言人表示,中方”反对划意识形态线、泛化国家安全概念”,但这是对芯片管制议题的整体表态,并非针对蒸馏指控的具体回应。

马斯克在X平台发帖讽刺:”他们怎么敢偷Anthropic从人类程序员那里偷来的东西?”获得超过60万次浏览和1.3万次转发。这句话击中了一个核心矛盾:就在一个月前,《华盛顿邮报》刚刚根据法庭解封文件曝光了Anthropic内部代号”巴拿马计划”的秘密行动——从2024年起,公司花费数千万美元大量购入实体书,用液压切割机切掉书脊扫描后销毁。内部文件写道:”我们不希望外界知道我们在做这件事。”此前Anthropic联合创始人还曾从盗版网站下载超过700万本书。2025年,Anthropic以15亿美元和解了相关版权集体诉讼。

中文技术社区CSDN和极道论坛上的讨论更为直接:Anthropic自己未经授权使用版权内容训练模型,现在却指控别人”窃取”AI输出——本质上所有AI公司都在”用别人的数据喂养自己的模型”,区别只在于谁有权定义哪种”使用”是合法的。

这份报告和美国对华芯片出口管制有什么关系?

Anthropic在报告中专门论证了一个政策观点:芯片出口管制不但有用,而且应该更严。

背景是这样的:2022年起,美国陆续限制向中国出口高端AI芯片,目的是拖慢中国AI发展。但DeepSeek去年发布R1后,很多人认为中国用较低端芯片也能做出顶级模型,芯片管制的必要性受到质疑。特朗普政府2025年12月确实放松了限制,批准Nvidia向中国出口H200芯片(美国政府抽取25%销售收入)。国会鹰派对此强烈反对,众议院外交事务委员会今年1月通过的《AI监督法案》甚至要求撤销已发放的出口许可。

Anthropic的报告恰在这个辩论白热化时反驳了”管制无用论”。它的论点是:DeepSeek之所以进步快,并非不需要好芯片,而是通过蒸馏”提取”了美国模型的能力——而大规模蒸馏本身也需要大量算力。报告明确写道:”蒸馏攻击强化了出口管制的理由:限制芯片供应既能限制直接训练前沿模型,也能限制蒸馏攻击的规模。”

Anthropic、OpenAI、Google在11天内先后发声却都没有起诉——为什么?

时间线值得注意:2月12日,OpenAI向众议院中国特别委员会提交备忘录指控DeepSeek蒸馏ChatGPT;2月23日,Anthropic发布详细博客点名三家公司;同一天,Google威胁情报团队发布报告披露针对Gemini的提取行为。三家美国AI公司在11天内先后披露蒸馏问题,但没有任何一家提起法律诉讼。

这不是偶然。独立AI媒体Implicator的分析一针见血:“蒸馏攻击是真实的,游说运动也是真实的。”所谓”合法”和”非法”蒸馏之间的法律界线,完全建立在服务条款上,至今没有法院对此做过裁决。实际上2023年Google的Bard团队就曾被曝使用ChatGPT输出训练自家模型——AI行业互相”蒸馏”并非新鲜事。

不起诉但高调公开,更像是一次面向华盛顿的协调行动。Anthropic的报告读起来不像安全披露,更像政策简报——专门设有”出口管制”和”国家安全影响”章节,核心论点是”蒸馏攻击证明出口管制有效且必要”。WebProNews直接指出报告”同时服务多个目的:将公司定位为负责任的安全行为者,增强其在监管讨论中的话语权”。Tech Buzz China分析师Rui Ma的评论值得深思:Anthropic”一直将算力领先定位为国家安全优先事项”,蒸馏攻击叙事”无论是否有意为之,都强化了加严芯片出口管制的理由”——Anthropic本身就是芯片管制的受益者,中国竞争对手获取算力越困难,就越难追赶它。

这一切对于普通中国用户来说,意味着什么?

如果美国进一步收紧——封堵代理渠道、加强API身份验证——中国用户和开发者使用美国前沿模型的难度会持续上升。

RAND智库研究员指出,OpenAI和Anthropic选择此时升级指控的一个可能原因是”阻止中国公司获取更多芯片和模型能力,从而让美国模型保持领先”。如果蒸馏被成功定性为”国家安全威胁”,未来中国AI公司获取美国模型输出的所有途径都可能被堵死。

反过来,这也可能推动中国AI走更独立的路线。中国科技巨头过去一个月密集发布新的开源模型——智谱开源了GLM-5(使用华为芯片训练)、阿里发布Qwen3.5、字节跳动推出豆包2.0——显示出加速自主研发的意愿。但正如Anthropic的指控所揭示的,DeepSeek R1的快速进步本身可能就部分依赖于对美国模型的蒸馏——真正脱离美国技术的独立发展,代价可能比表面看起来更大。

对普通中国用户来说,这场博弈最终可能意味着:你能用到的AI工具与美国用户之间的差距,会随着”脱钩”加深而扩大;选择使用哪家公司的AI产品,正在从一个纯技术选择变成带有地缘政治色彩的决定;而AI模型中内嵌的审查和叙事倾向——无论来自中国政府的法律要求还是美国公司的价值观设定——都会以你可能察觉不到的方式影响你获取信息的质量。

🔗 参考来源

TechCrunch — Anthropic accuses Chinese AI labs of mining Claude

CNBC — Anthropic joins OpenAI in flagging distillation campaigns

路透社 — DeepSeek trained AI model on Nvidia Blackwell chips despite US ban

Implicator — Distillation Attacks on Claude Are Real. So Is the Lobbying Campaign.

NIST/CAISI — Evaluation of DeepSeek AI Models Finds Shortcomings and Risks

《华盛顿邮报》— Inside a tech company’s secretive plan to destroy millions of books

Tom’s Hardware — Anthropic accuses Chinese AI developers of industrial-scale copying

外交关系委员会(CFR) — The Consequences of Exporting Nvidia’s H200 Chips to China

Agnost AI — Distillation Attacks: How AI Labs Are Stealing Capabilities at Industrial Scale